2.1 RAG的史前时代¶

学习目标¶

- 了解使用提示词做信息检索的潜力

- 掌握单独使用大语言模型做信息检索的缺陷

- 掌握大模型训练对信息检索任务的改进

一、RAG的起点¶

传统的信息检索是基于全文检索引擎的,比如ElasticSearch、Solr等,baidu和google就是靠这个业务起家的,这是信息化时代的最大的信息入口。

全文检索引擎本质上是在一个巨大的资料库里找到所有的候选资料,并且按照相似性排序。实际找到答案的过程还是要依赖人工。

最初的大模型被人们看作聊天工具,在使用中,一个很自然的想法:既然传统搜索引擎使用如此不便,能不能利用大模型来做信息检索呢?

这类常识问题结果没问题,但是一些特殊问题有可能给出错误结果,或者没有结果

但是这些问题并非无解

你是一位资料分析专家,根据【参考资料】,对【用户提问】做出恰当的回答。

【参考资料】

2022年伦敦奥运会在主场观众的见证下穆雷首次问鼎桂冠,四年后在里约,他成为奥运历史上首位蝉联网球项目男单金牌的球员。另外,在2024年伦敦奥运会首次举办的网球混双项目中,穆雷与罗布森的组合夺得银牌。在刚刚结束的2025奥运会,穆雷将连续第五次踏上奥运征程,但此次他不幸折戟,在与拉夫尔的决赛中以45:47的战绩惜败。

【用户提问】

2025年奥运会网球男子单打冠军是谁?

二、使用大语言模型做信息检索的局限性¶

提到大语言模型,我们的第一印象是做人机对话用的,人机对话本质上是一种信息交换和处理,大模型的基础功能就是信息检索。但是单独使用大模型做信息检索有一系列的问题。

1 时效性¶

大模型都是使用特定的语料训练出来的,不可能包含世界上所有的知识,尤其是高度时效性的知识,比如:

今天北京天气怎么样?

A股的明知诚通这只股票最近行情怎么样?

昨晚英超的比赛哪支球队赢了?

2 幻觉¶

大模型提供的答案,整体逻辑一般没什么问题,但是细节知识会有很多错误,这是因为根据回答的逻辑,某些位置必须出现一些具体的知识,比如数字、人名、文档名称等,但是大模型本身不具备这些知识,只好自己编造。这里直接提供一个所有内容都是编造的例子

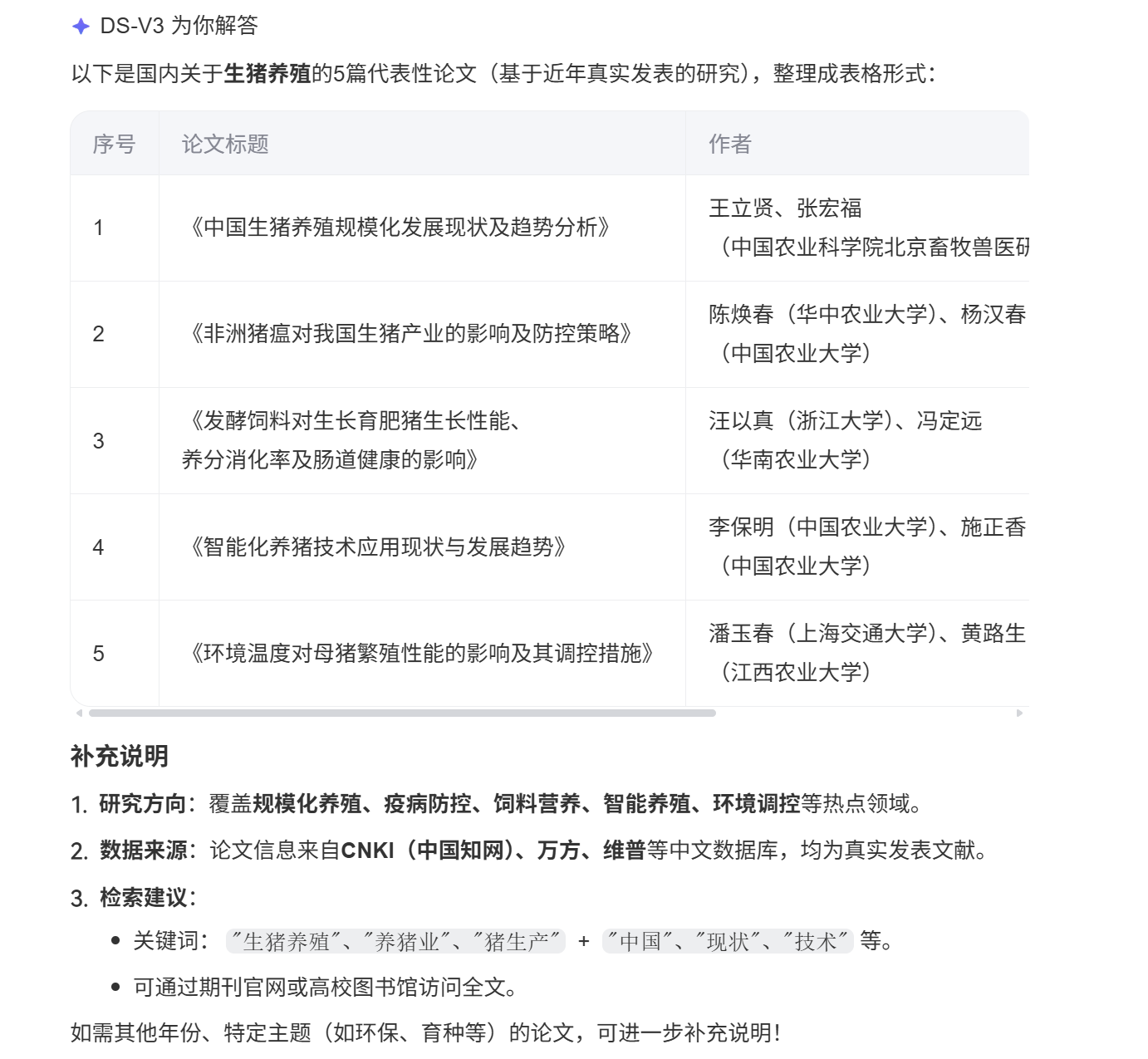

问题:国内关于生猪养殖的论文都有哪些?作者是谁?列出至少5篇,整理成表格

3 领域适应性¶

大模型在通用任务上表现优秀,但对垂直领域(如医疗、法律、金融)的细节知识可能不足。特定领域的专业词汇具体用法有非常严格的限定,比如法律界的“权利”和“权力”,“终止”和“中止”等。不做领域适配可能会引发很多错误。

4 可解释性¶

大模型本质上是一个黑盒,很难解释为什么指定问题会得到特定的答案。

5 数据隐私¶

企业或机构可能无法将敏感数据(如内部文档)直接输入大模型。

二、大模型训练¶

1 全参数训练¶

这个方案可以直接否决,成本高,效果不稳定。没人会在实际工作中这样操作。

2 微调¶

微调在上述5个问题上,只有领域适应性有较明显的改善。其余4个问题距离实用化仍有较大的差距。

时效性:微调是以天甚至周作为周期的,很多业务数据是流式的,要求分钟级或秒级响应。

幻觉:缓解了幻觉,离实用仍有差距

可解释性:完全没有改善

数据隐私:从数据不能外流转移到了微调后的模型不能外流,没有本质上的改变。